报道机器之心

参与:一鸣

漫画挖掘是汉化组翻译中必不可少的工作,工作量大。主要内容是挖掘漫画中的文字,以取代另一种语言。现在,这项工作可以自动完成。一位韩国开发者开源了一种工具。借助深度学习模型,他可以一键挖掘漫画中的文字,甚至背景图中的文字也可以挖掘出来。效果非常惊人。

项目地址:https://github.com/KUR-creative/SickZil-Machine

许多人喜欢看日本漫画,许多作品已经成为许多人心中的童年记忆。但对于漫画翻译来说,他们需要删除原始漫画的对话框和背景文本,并用读者使用的语言替换它。因为漫画可能有成千上万的对话框和对话,所以工作量很大。

现在,抠图的工作人员基本上可以解放双手。只要你有 TensorFlow,一键抠图可以快速实现,一键去除漫画图像中的所有文字。

SickZil-Machine,一键抠图

SickZil 作者在韩语中提供了一段视频来显示这个工具的效果。

作者还提供了自动工具挖掘的案例。

对话框中的文本可以完全消除。

有时有些文本会消除不干净的情况,但它们基本上不会影响图片(卡通右上角的标题符号)。同时,在背景中删除文本后,背景图片可以自动完成,基本上不会改变图片效果(图片右上角的背景文本)。

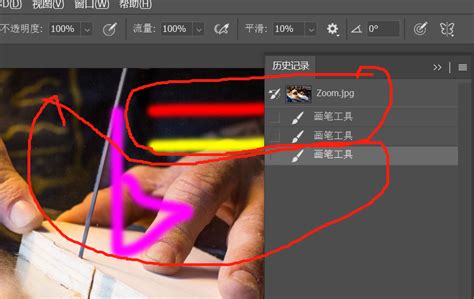

从视频中可以看出,这个工具非常方便。只需选择待处理的漫画,然后操作工具即可。如果有些图片被误删除,或者有些不干净,用户可以手动修改需要删除的文本。

那么,这个工具背后有哪些技术呢?

技术

模型架构

据项目作者介绍,这个工具背后有两个模型,第一个是 Seg Net,用来检测漫画中的问题。另一个是 Compl Net,用于处理漫画图像,去除文本,补充缺失的图像部分。

Seg Net 使用的是 U-NET。这是一种编码器-解码器架构。编码器逐渐降低池层的空间维度,解码器逐渐修复物体的细节和空间维度。

U-Net 将输入图像逐渐池化,然后进行上采样,以恢复图像细节。

而 Compl Net 使用的是 deepfill v2.这是对任何被任意被任意使用的 mask 修复图像的模型可以适应各种图像 mask 方法(块盖或线盖都可以)。deepfill 是 Adobe 当机构提出一系列图像修复工具时,机器的心也被使用了 deepfill v1.但效果似乎没有论文展示的那么好。

目前 deepfill v2 没有官方开源,但是 GitHub 还有其他开发者复现。

deepfill v2 可以修复图像的模型架构。

有了这两个神器,基本上可以实现漫画文字的检测识别和去除文本后的图像补充。

数据集和训练

模型还不够,很多读者都想知道整个系统是如何训练的。

在 Seg Net 在上面,作者使用原始漫画图像和文本内容来覆盖数据,以覆盖原始漫画中的所有文本部分。 Compl Net 在上面,模型的输入是删除文本的漫画图像。模型使用 285 图像-覆盖对和 31500 其中近乎有张漫画图像 12000 张漫画有文字,所以训练数据相对平衡。

安装和使用

作者没有透露训练模型的相关参数,但提供了开发者需要准备的硬件配置。

对于开发者来说,需要准备运行代码 NVIDIA 驱动 410.x,CUDA 10.0,CUDNN >= 7.4.1,TensorFlow 需要大于 1.13 版本。

配置代码步骤如下:

首先,克隆相关代码:git clone https://github.com/KUR-creative/SickZil-Machine.git; cd SickZil-Machine下载 zip 文件,地址:https://github.com/KUR-creative/SickZil-Machine/releases。解压复制文件:SickZil-Machine-0.1.1-pre0-win64-cpu-eng/resource/cnet 和 SickZil-Machine-0.1.1-pre0-win64-cpu-eng/resource/snet 到文件目录:SickZil-Machine/resource.进入目录并安装:pip install -r requirements.txt操作主程序:cd src; python main.py声明:易商讯尊重创作版权。本文信息搜集、整理自互联网,若有来源标记错误或侵犯您的合法权益,请联系我们。我们将及时纠正并删除相关讯息,非常感谢!